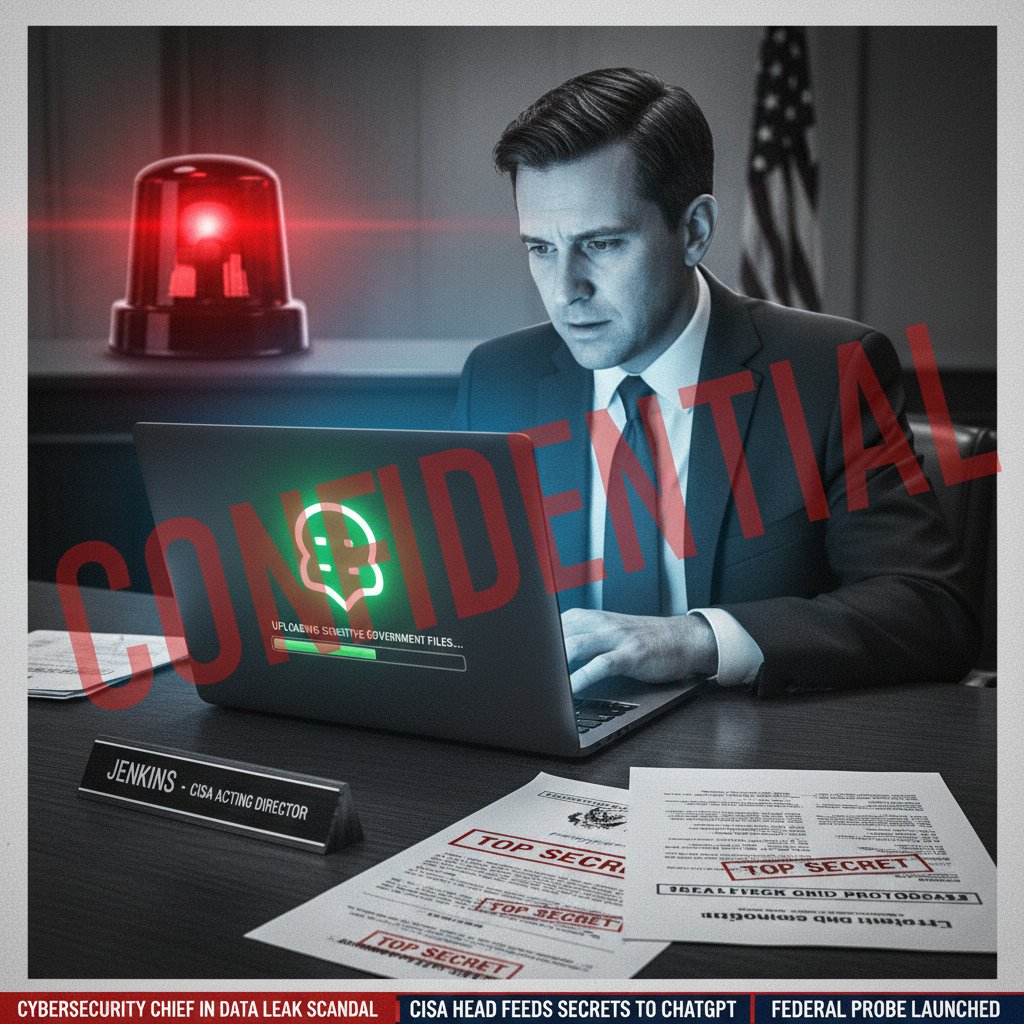

Il capo della cybersecurity USA carica documenti sensibili su ChatGPT: scandalo sicurezza

Un episodio clamoroso scuote la sicurezza nazionale americana: il responsabile ad interim della principale agenzia di cybersecurity ha caricato documenti sensibili su una versione pubblica di ChatGPT, tool di intelligenza artificiale accessibile a milioni di utenti. Questo ha attivato immediatamente sistemi di allerta interni, portando a una valutazione dei danni da parte del Dipartimento della sicurezza interna. La soluzione rapida per evitare rischi simili? Usa solo versioni enterprise di IA con controlli privacy rigorosi e vieta l’upload di dati sensibili su tool pubblici.

In un’epoca in cui l’intelligenza artificiale è al centro delle strategie governative, questo incidente rivela vulnerabilità paradossali proprio all’interno delle strutture preposte a difendere le reti critiche. Immagina il paradosso: chi dovrebbe proteggere le infrastrutture digitali finisce per esporle involontariamente. L’evento risale allo scorso estate, ma le sue implicazioni riecheggiano ancora oggi, spingendo a riflettere su politiche più stringenti per l’uso dell’IA nel settore pubblico.

Il contesto dell’incidente

Madhu Gottumukkala, nominato direttore facente funzione della Cybersecurity and Infrastructure Security Agency (Cisa) a maggio, ha ottenuto un’autorizzazione speciale per accedere a ChatGPT. Mentre per la maggior parte dei dipendenti del Dipartimento della Sicurezza Interna (Dhs) l’accesso era bloccato – proprio per prevenire fughe di dati – Gottumukkala ha ricevuto un’eccezione temporanea e limitata. Questa decisione, presa dall’ufficio del Chief Information Officer della Cisa, mirava a testare l’tool per scopi contrattuali.

Tuttavia, a inizio agosto, i sistemi di monitoraggio cybersecurity hanno rilevato upload di quattro documenti contrattuali contrassegnati come “For Official Use Only”. Questi file, pur non essendo classificati top-secret, contenevano informazioni sensibili destinate esclusivamente a un uso interno governativo. La versione pubblica di ChatGPT, sviluppata da OpenAI, condivide i dati inseriti con i server dell’azienda per addestrare i modelli e rispondere ad altre query, esponendoli potenzialmente a 700 milioni di utenti globali.

Il Dhs ha risposto prontamente avviando una valutazione dei danni, per verificare se le informazioni fossero state compromesse o utilizzate da terze parti. Un portavoce della Cisa ha confermato che l’uso era stato autorizzato con controlli in atto, ma l’incidente ha comunque generato tensioni interne e critiche da parte di funzionari anonimi.

Implicazioni per la sicurezza nazionale

Questo caso non è isolato nel tenure di Gottumukkala. Si parla di precedenti problemi, come un presunto fallimento in un test del poligrafo per l’accesso a intelligence altamente sensibile, sebbene egli abbia negato tali accuse durante un’audizione congressuale. La Cisa, incaricata di difendere le infrastrutture critiche da minacce straniere come Russia e Cina, si trova ora sotto scrutinio per un’autolesione digitale.

Nel frattempo, l’amministrazione statunitense promuove attivamente l’adozione dell’IA nelle agenzie federali. Un ordine esecutivo ha limitato le regolamentazioni statali sull’IA, mentre il Pentagono ha annunciato una strategia “AI-first” per l’uso militare dell’intelligenza artificiale. Questi sviluppi contrastano con l’episodio, evidenziando la necessità di bilanciare innovazione e sicurezza.

La portavoce della Cisa, Marci McCarthy, ha minimizzato l’accaduto, sottolineando che i controlli erano presenti e l’uso limitato. Tuttavia, l’incidente solleva domande su protocolli di accesso privilegiato e formazione del personale. Il Senato non ha ancora confermato un direttore permanente, lasciando Gottumukkala in carica e amplificando le controversie.

Rischi dell’IA pubblica nei contesti sensibili

ChatGPT e tool simili sono potenti per l’analisi rapida di documenti, ma la loro natura pubblica li rende inadatti per dati governativi. Gli input vengono processati su server remoti, senza garanzie di non-condivisione. Questo ha portato molte organizzazioni a bloccare l’accesso, optando per versioni enterprise con data retention zero.

In Italia e in Europa, normative come il GDPR impongono standard elevati per la protezione dati, rendendo incidenti simili ancora più improbabili ma non impossibili. Le agenzie europee stanno adottando approcci cauti, privilegiando soluzioni on-premise o cloud certificati.

Per le aziende private, la lezione è chiara: audita regolarmente l’uso di IA da parte dei dipendenti e implementa policy DLP (Data Loss Prevention). Strumenti come watermarking digitale e monitoraggio AI-specifico possono prevenire upload non autorizzati.

Evoluzione delle policy IA governative

L’episodio ha accelerato discussioni su regolamentazioni federali. Negli USA, si parla di linee guida più severe per l’uso di large language model (LLM) in ambienti sensibili. OpenAI sta rispondendo con prodotti dedicati, come versioni sicure per il settore pubblico.

Queste iniziative mirano a integrare l’IA senza compromettere la sovereignty dei dati. In Europa, l’AI Act classifica i sistemi ad alto rischio, imponendo obblighi stringenti per applicazioni governative.

Ora, approfondiamo con dettagli tecnici.

Approfondimento tecnico

Meccanismi di allerta e DLP

I sistemi di monitoraggio del Dhs utilizzano soluzioni avanzate di Data Loss Prevention (DLP), che scansionano il traffico outbound alla ricerca di pattern sensibili. Keyword matching, regex per etichette come “For Official Use Only” e machine learning per anomaly detection hanno flaggato gli upload. Una volta attivato, il workflow include:

- Quarantena automatica dei dati.

- Notifica istantanea al security operations center (SOC).

- Damage assessment con forensic analysis per tracciare esposizione.

Strumenti come Microsoft Purview o Symantec DLP integrano regole per API di ChatGPT, bloccando endpoint noti (es. api.openai.com).

Architettura di ChatGPT pubblico vs enterprise

La versione pubblica invia prompt a modelli GPT su Azure, con retention dati per training (opt-out limitato). Enterprise editions, come ChatGPT Enterprise, offrono:

- Zero data retention: input cancellati post-elaborazione.

- SOC2 compliance e audit log.

- Hosting dedicato, senza condivisione con altri tenant.

Per governi, emergono varianti come ChatGPT Gov, basate su Azure Government Cloud, conformi a FedRAMP High e CJIS. Queste usano enclave hardware sicure (es. Confidential Computing) per crittografia end-to-end.

| Caratteristica | ChatGPT Pubblico | ChatGPT Enterprise/Gov |

|---|---|---|

| Data retention | Sì, per training | No |

| Compliance | Base | FedRAMP, GDPR, HIPAA |

| Isolamento tenant | No | Sì, dedicato |

| Monitoraggio custom | No | Sì, API logs |

Mitigazioni avanzate

Per prevenire ricorrenze:

- Endpoint protection: CASB (Cloud Access Security Broker) per shadow IT.

- AI governance frameworks: Strumenti come IBM Watsonx.governance per policy enforcement.

- Zero-trust architecture: Verifica continua, mai fidarsi di privilegi.

Codice esemplificativo per un proxy DLP (Python):

import re

def check_sensitive_content(text):

patterns = [

r'For Official Use Only',

r'\bCISA\b',

r'\bDHS\b'

]

for pattern in patterns:

if re.search(pattern, text, re.IGNORECASE):

return True # Block upload

return False

# Esempio uso

prompt = "Analizza questo contratto: For Official Use Only..."

if check_sensitive_content(prompt):

print("Upload bloccato: dati sensibili rilevati.")

Impatti a lungo termine

Dal punto di vista threat modeling, questo incidente amplifica vettori come prompt injection o data exfiltration. Agenzie come Cisa ora priorizzano red teaming su LLM, simulando attacchi insider. La formazione è cruciale: corsi su secure AI usage riducono errori umani del 70%, secondo studi NIST.

In conclusione tecnica, l’evento sottolinea la gap tra hype IA e maturity operativa. Transizioni verso modelli federated learning o on-device inference minimizzeranno esposizioni future, mantenendo benefici senza rischi.